FAST version of the notebook:¶

Faster than training from scratch - Fine-tuning the English GPT-2 in any language with Hugging Face and fastai v2 (practical case with Portuguese)¶

Tutorial on how to use fastai v2 over Hugging Face's Transformers and Tokenizers libraries to fine-tune an English pre-trained transformer-based language model (GPT-2) to any language other than English

- Author: Pierre Guillou

- Date: July 2020 (14/07/2020)

- Post in medium: Faster than training from scratch - Fine-tuning the English GPT-2 in any language with Hugging Face and fastai v2 (practical case with Portuguese)

- Notebook with all explanation: finetuning-English-GPT2-any-language-Portuguese-HuggingFace-fastaiv2.ipynb

- Hugging face model page of GPorTuguese-2: a language model for Portuguese text generation (and more NLP tasks...)

- Other posts in medium of the GPT-2 series:

Overview¶

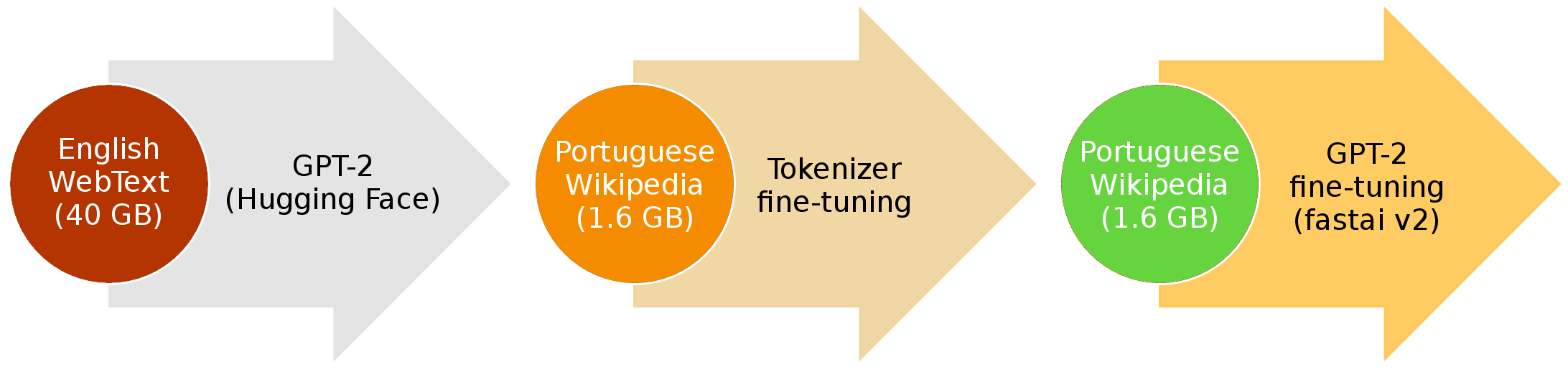

In this tutorial, instead of training from scratch, we will see how to fine-tune in just over a day, on one GPU and with a little more than 1GB of training data an English pre-trained transformer-based language model to any another language.

As a practical case, we fine-tune to Portuguese the English pre-trained GPT-2 by wrapping the Transformers and Tokenizers libraries of Hugging Face into fastai v2. We thus create a new language model: GPorTuguese-2, a language model for Portuguese text generation (and more NLP tasks...).

Acknowledgment¶

This tutorial was made possible thanks to the computing power of the AI Lab (University of Brasilia) to which I am attached as an Associate Researcher in NLP and the participation of its directors in the definition of the NLP strategy, Professors Fabricio Ataides Braz and Nilton Correia da Silva. Thank you so much!

And special thanks to Sylvain Gugger for his tutorial on Transformers and fastai v2 which is the basis of this tutorial.

Post, notebooks, Web App and model download¶

The main code of the tutorial is published in this post (Faster than training from scratch - Fine-tuning the English GPT-2 in any language with Hugging Face and fastai v2 (practical case with Portuguese)), organized by paragraph.

The complete code is in this notebook. However, as this notebook is very detailed, you can use this fast notebook finetuning-English-GPT2-any-language-Portuguese-HuggingFace-fastaiv2_FAST.ipynb (nbviewer version) if you just want to execute the code without explanation.

In addition, our GPorTuguese-2 (Portuguese GPT-2 small) , a language model for Portuguese text generation (and more NLP tasks...), is testable online in the Hugging face model hub with all usage information at this address: https://huggingface.co/pierreguillou/gpt2-small-portuguese

Main coding steps to fine-tune a Hugging Face language model with fastai v2¶

The 6 main steps detailed below can be summarized in 3 main ones:

- Initialization & download (download of Portuguese Wikipedia and GPT-2 English pre-trained model and tokenizer)

- GPT-2 tokenizer with a Portuguese vocab (train a GPT-2 tokenizer with a vocab in Portuguese, wrap it into a fastai v2 tokenizer and update the embeddings matrix of the GPT-2 English pre-trained model according to the new Portuguese vocab: keep the embeddings vectors of the common tokens between English and Portuguese vocabs)

- Fine-tune on Portuguese Wikipedia the GPT-2 model with fastai v2 training functionalities

1. Initialization¶

from fastai2.text.all import *

from nlputils_fastai2 import *

%reload_ext autoreload

%autoreload 2

%matplotlib inline

gpu = 0

torch.cuda.set_device(gpu)

print(f'cuda device: {torch.cuda.current_device()}')

# print(f'cuda device name: {torch.cuda.get_device_name(gpu)}')

cuda device: 0

# Get config of paths

config = Config()

config.d

{'archive_path': '/storage/archive/',

'data_path': '/storage/data/',

'model_path': '/storage/models/',

'storage_path': '/storage/data/',

'version': 2}

This will create a {lang}wiki folder, containing a {lang}wiki text file with the wikipedia contents. (For other languages, replace {lang} with the appropriate code from the list of wikipedias.)

lang = 'pt'

# setup new path_data and create the corresponding folder

name = f'{lang}wiki'

data_path = config['data_path']

path_data = data_path/name

path_data.mkdir(exist_ok=True, parents=True)

2. Download Wikipedia in Portuguese¶

Note: all the following methods come from the file nlputils_fastai2.py.

Path.cwd(), path_data

(Path('/mnt/home/pierre/course-v4/nbs'),

Path('/mnt/home/pierre/.fastai/data/ptwiki'))

get_wiki(path_data,lang)

/mnt/home/pierre/.fastai/data/ptwiki/ptwiki already exists; not downloading

If get_wiki(path_data,lang) breaks, fix the download manually no terminal:

- mkdir -p /mnt/home/pierre/.fastai/data/ptwiki

- cd /mnt/home/pierre/.fastai/data/ptwiki

- wget -c https://dumps.wikimedia.org/ptwiki/latest/ptwiki-latest-pages-articles.xml.bz2

- bzip2 -dk ptwiki-latest-pages-articles.xml.bz2

And re-run get_wiki(path_data,lang) once the download is successful.

!head -n4 {path_data}/{name}

<doc id="220" url="https://pt.wikipedia.org/wiki?curid=220" title="Astronomia"> Astronomia Astronomia é uma ciência natural que estuda corpos celestes (como estrelas, planetas, cometas, nebulosas, aglomerados de estrelas, galáxias) e fenômenos que se originam fora da atmosfera da Terra (como a radiação cósmica de fundo em micro-ondas). Preocupada com a evolução, a física, a química e o movimento de objetos celestes, bem como a formação e o desenvolvimento do universo.

dest = split_wiki(path_data,lang)

/mnt/home/pierre/.fastai/data/ptwiki/docs already exists; not splitting

dest = path_data/'docs'

for file in dest.ls()[:5]:

print(file)

/mnt/home/pierre/.fastai/data/ptwiki/docs/Fotografia.txt /mnt/home/pierre/.fastai/data/ptwiki/docs/Espadanedo (Macedo de Cavaleiros).txt /mnt/home/pierre/.fastai/data/ptwiki/docs/Jacques-Germain Soufflot.txt /mnt/home/pierre/.fastai/data/ptwiki/docs/Faculdade de Medicina da Universidade de São Paulo.txt /mnt/home/pierre/.fastai/data/ptwiki/docs/Escola do Teatro Bolshoi no Brasil.txt

%%time

# Size of downloaded data in the docs folder

num_files, num_tokens = get_num_tokens(dest)

print(f'{num_files} files - {num_tokens} tokens')

203205 files - 193686269 tokens CPU times: user 1min, sys: 20.8 s, total: 1min 21s Wall time: 11min 16s

Create text and csv files of wikipedia in Portuguese¶

dest = path_data/'docs'

Text file¶

%%time

get_one_clean_file(dest,lang)

csv file¶

%%time

get_one_clean_csv_file(dest,lang)

3. Download a GPT-2 English pre-trained model and train a GPT-2 tokenizer with a vocab in Portuguese¶

We are following 3 steps in order to get a GPT-2 tokenizer with the vocab in Portuguese:

- 3.1) Get the pre-trained GPT-2 Tokenizer & Model (pre-training with an English corpus) from the Transformers library (Hugging Face): it will give us the tokenizer structure we need and the pre-trained model weights (it's better to start training our GPT-2 model in Portuguese from weights already trained even in another language than from random values)

- 3.2) Train a Byte-level BPE (BBPE) Tokenizer on the Portuguese Wikipedia corpus by using the Tokenizers library (Hugging Face): this will give us the vocabulary files in Portuguese of our GPT-2 tokenizer.

- 3.3) Import the tokenizer Portuguese config files into the pre-trained GPT-2 Tokenizer: it will give us a GPT-2 tokenizer structure with the vocab in Portuguese.

3.1 Get the pre-trained GPT2 Tokenizer & Model (pre-training with an English corpus)¶

# ! pip install transformers

!pip freeze | grep transformers

transformers==3.0.0

from transformers import GPT2TokenizerFast, GPT2LMHeadModel

%%time

pretrained_weights = 'gpt2'

tokenizer_en = GPT2TokenizerFast.from_pretrained(pretrained_weights)

model_en = GPT2LMHeadModel.from_pretrained(pretrained_weights)

Some weights of GPT2LMHeadModel were not initialized from the model checkpoint at gpt2 and are newly initialized: ['h.0.attn.masked_bias', 'h.1.attn.masked_bias', 'h.2.attn.masked_bias', 'h.3.attn.masked_bias', 'h.4.attn.masked_bias', 'h.5.attn.masked_bias', 'h.6.attn.masked_bias', 'h.7.attn.masked_bias', 'h.8.attn.masked_bias', 'h.9.attn.masked_bias', 'h.10.attn.masked_bias', 'h.11.attn.masked_bias', 'lm_head.weight'] You should probably TRAIN this model on a down-stream task to be able to use it for predictions and inference.

CPU times: user 13 s, sys: 922 ms, total: 13.9 s Wall time: 7.48 s

# To correct the warning about token_pad (GPT2TokenizerFast), run the following code

# source: https://github.com/huggingface/transformers/issues/2648#issuecomment-616177044

tokenizer_en.pad_token = tokenizer_en.eos_token

3.2 Train a Byte Level BPE (BBPE) Tokenizer on the Portuguese Wikipedia¶

# !pip install tokenizers

!pip freeze | grep tokenizers

tokenizers==0.8.0

Training¶

# Get GPT2 tokenizer_en vocab size

ByteLevelBPE_tokenizer_pt_vocab_size = tokenizer_en.vocab_size

ByteLevelBPE_tokenizer_pt_vocab_size

50257

%%time

# ByteLevelBPETokenizer Represents a Byte-level BPE as introduced by OpenAI with their GPT-2 model

from tokenizers import ByteLevelBPETokenizer

ByteLevelBPE_tokenizer_pt = ByteLevelBPETokenizer()

# Get list of paths to corpus files

paths = [str(path_data/'all_texts_ptwiki.txt')]

# Customize training with <|endoftext|> special GPT2 token

ByteLevelBPE_tokenizer_pt.train(files=paths,

vocab_size=ByteLevelBPE_tokenizer_pt_vocab_size,

min_frequency=2,

special_tokens=["<|endoftext|>"])

# Get sequence length max of 1024

ByteLevelBPE_tokenizer_pt.enable_truncation(max_length=1024)

# save tokenizer

ByteLevelBPE_tokenizer_pt_rep = 'ByteLevelBPE_tokenizer_pt'

path_to_ByteLevelBPE_tokenizer_pt_rep = path_data/ByteLevelBPE_tokenizer_pt_rep

if not (path_to_ByteLevelBPE_tokenizer_pt_rep).exists():

path_to_ByteLevelBPE_tokenizer_pt_rep.mkdir(exist_ok=True, parents=True)

ByteLevelBPE_tokenizer_pt.save_model(str(path_to_ByteLevelBPE_tokenizer_pt_rep))

CPU times: user 5h 47min 23s, sys: 43min 12s, total: 6h 30min 35s Wall time: 10min 52s

['/mnt/home/pierre/.fastai/data/ptwiki/ByteLevelBPE_tokenizer_pt/vocab.json', '/mnt/home/pierre/.fastai/data/ptwiki/ByteLevelBPE_tokenizer_pt/merges.txt']

We now have both a vocab.json, which is a list of the most frequent tokens ranked by frequency, and a merges.txt list of merges.

Check our tokenizer pre-trained in Portuguese¶

# Load the tokenizer ByteLevelBPE_tokenizer_pt

from tokenizers import ByteLevelBPETokenizer

# Get the path to ByteLevelBPE_tokenizer_pt config files

ByteLevelBPE_tokenizer_pt_rep = 'ByteLevelBPE_tokenizer_pt'

path_to_ByteLevelBPE_tokenizer_pt_rep = path_data/ByteLevelBPE_tokenizer_pt_rep

ByteLevelBPE_tokenizer_pt = ByteLevelBPETokenizer(

vocab_file=f'{path_to_ByteLevelBPE_tokenizer_pt_rep}/vocab.json',

merges_file=f'{path_to_ByteLevelBPE_tokenizer_pt_rep}/merges.txt'

)

# Get sequence length max of 1024

ByteLevelBPE_tokenizer_pt.enable_truncation(max_length=1024)

4. Create a fastai tokenizer and update the embeddings matrix of the GPT-2 English pre-trained model¶

Now let's see how we can use fastai v2 to fine-tune this model on Wikipedia in Portuguese, using all the fastai v2 training utilities.

We will follow these 2 following steps:

- 4.1) GPT2TokenizerFast (imported GPT-2 tokenizer) --> fastai Tokenizer: to process the data to train a model, we need to build a fastai tokenizer from the GPT-2 tokenizer with vocab in Portuguese.

- 4.2) Change vocab embeddings (wte matrix) in the GPT-2 pre-trained model to adapt to the Portuguese vocab: as the vocab embedding matrix (wte) of the pre-trained GPT-2 model corresponds to the English vocabulary, we'll keep the embeddings vectors of the common tokens between the English and Portuguese vocab.

from fastai2.text.all import *

4.1 GPT2TokenizerFast (imported GPT-2 tokenizer) --> fastai Tokenizer¶

class TransformersTokenizer(Transform):

def __init__(self, tokenizer): self.tokenizer = tokenizer

def encodes(self, x):

toks = self.tokenizer.tokenize(x)

return tensor(self.tokenizer.convert_tokens_to_ids(toks))

def decodes(self, x): return TitledStr(self.tokenizer.decode(x.cpu().numpy()))

Tokenizers¶

%%time

# Load the GPT2 tokenizer in English

from transformers import GPT2TokenizerFast, GPT2LMHeadModel

pretrained_weights = 'gpt2'

tokenizer_en = GPT2TokenizerFast.from_pretrained(pretrained_weights)

model_en = GPT2LMHeadModel.from_pretrained(pretrained_weights)

# To correct the warning about token_pad (GPT2TokenizerFast), run the following code

# source: https://github.com/huggingface/transformers/issues/2648#issuecomment-616177044

tokenizer_en.pad_token = tokenizer_en.eos_token

Some weights of GPT2LMHeadModel were not initialized from the model checkpoint at gpt2 and are newly initialized: ['h.0.attn.masked_bias', 'h.1.attn.masked_bias', 'h.2.attn.masked_bias', 'h.3.attn.masked_bias', 'h.4.attn.masked_bias', 'h.5.attn.masked_bias', 'h.6.attn.masked_bias', 'h.7.attn.masked_bias', 'h.8.attn.masked_bias', 'h.9.attn.masked_bias', 'h.10.attn.masked_bias', 'h.11.attn.masked_bias', 'lm_head.weight'] You should probably TRAIN this model on a down-stream task to be able to use it for predictions and inference.

CPU times: user 16.3 s, sys: 831 ms, total: 17.1 s Wall time: 6.94 s

# Get the path to ByteLevelBPE_tokenizer_pt config files

ByteLevelBPE_tokenizer_pt_rep = 'ByteLevelBPE_tokenizer_pt'

path_to_ByteLevelBPE_tokenizer_pt_rep = path_data/ByteLevelBPE_tokenizer_pt_rep

# import the pre-trained GPT2TokenizerFast tokenizer with the tokenizer_pt config files

tokenizer_pt = GPT2TokenizerFast.from_pretrained(

str(path_to_ByteLevelBPE_tokenizer_pt_rep),

pad_token='<|endoftext|>')

# Get sequence length max of 1024

tokenizer_pt.model_max_length = 1024

4.2 Change vocab embeddings (wte matrix) in the GPT-2 pre-trained model to adapt to the Portuguese vocab¶

Check vocabs size¶

tokenizer_fastai_en = TransformersTokenizer(tokenizer_en)

old_vocab_size = tokenizer_fastai_en.tokenizer.vocab_size

tokenizer_fastai_pt = TransformersTokenizer(tokenizer_pt)

new_vocab_size = tokenizer_fastai_pt.tokenizer.vocab_size

old_vocab_size,new_vocab_size,old_vocab_size-new_vocab_size

(50257, 50257, 0)

Changing vocabs and the vocab embeddings matrix (ie, setup new embeddings matrix)¶

# Get weights of the old wte

old_wgts = model_en.transformer.get_input_embeddings().weight.clone().detach()

# Get the mean embedding vetor of the old wte

wgts_m = old_wgts.mean(0)

# Initialize vocab size and weights of the new wte

new_vocab_size = tokenizer_fastai_pt.tokenizer.vocab_size

new_wgts = old_wgts.new_zeros(new_vocab_size,old_wgts.size(1))

Save

# Get the new wte keeping the embeddings vetors of tokens in common in the 2 vocabs

# A token present in the new vocab but not in the old one gets the mean embedding vetor of the old wte

old_vocab = tokenizer_fastai_en.tokenizer.get_vocab()

new_vocab = tokenizer_fastai_pt.tokenizer.get_vocab()

same_tokens_list = list()

different_tokens_list = list()

for w,idx_new in new_vocab.items():

idx_old = old_vocab.get(w, -1)

if idx_old>=0:

new_wgts[idx_new] = old_wgts[idx_old]

same_tokens_list.append((w,idx_new))

else:

new_wgts[idx_new] = wgts_m

different_tokens_list.append((w,idx_new))

# setup in model the new wte

new_wte = nn.Embedding(new_vocab_size,old_wgts.size(1))

#new_wte.weight.data.normal_(mean=0.0, std=model.config.initializer_range)

new_wte.weight.data = new_wgts

model_en.transformer.set_input_embeddings(new_wte)

print(f'Portuguese wte matrix setup done!\n\nWe kept {len(same_tokens_list)} embeddings vectors from the English one.\nWe did not kept {len(different_tokens_list)} embeddings vectors from the English one (instead, we used the old wte mean vector).\n')

# Check identical tokens between the 2 vocabs

num = 15

print(f'{num} first tokens IN common between the 2 vocabs:\n{same_tokens_list[:num]}\n')

print(f'{num} first tokens NOT in common between the 2 vocabs:\n{different_tokens_list[:num]}')

# save new_wgts

torch.save(new_wgts, path_data/'new_wte_wgts.pt')

# save same_tokens_list and different_tokens_list

torch.save(same_tokens_list, path_data/'same_tokens_list.pt')

torch.save(different_tokens_list, path_data/'different_tokens_list.pt')

Portuguese wte matrix setup done!

We kept 12948 embeddings vetors from the English one.

We did not kept 37309 embeddings vetors from the English one (we used the old wte mean vetor).

15 first tokens IN common between the 2 vocabs:

[('ĠQuit', 40195), ('Smith', 32470), ('Ġomit', 39040), ('oc', 574), ('ym', 18252), ('Ġactual', 9443), ('ck', 911), ('ĠPremier', 16558), ('Ġeste', 987), ('ĠInd', 3438), ('Ġbol', 4203), ('phen', 35836), ('ĠParticip', 36689), ('ĠZeus', 19316), ('Ġnan', 39770)]

15 first tokens NOT in common between the 2 vocabs:

[('PSDB', 23151), ('Ġenvio', 19270), ('Ġocupação', 5938), ('Ġdocumentada', 30011), ('Ġduros', 36706), ('visto', 44422), ('ĠSiro', 43061), ('Ġdestacavam', 47397), ('Ġarqui', 49060), ('ĠArte', 5977), ('ĠValor', 29721), ('Ġalinhados', 38446), ('Ġnúmeros', 4626), ('Ġpênis', 31686), ('cisa', 29710)]

Load

# load new_wgts

new_wgts = torch.load(path_data/'new_wte_wgts.pt')

# load same_tokens_list and different_tokens_list

same_tokens_list = torch.load(path_data/'same_tokens_list.pt')

different_tokens_list = torch.load(path_data/'different_tokens_list.pt')

# setup in model the new wte

new_wte = nn.Embedding(new_vocab_size,old_wgts.size(1))

new_wte.weight.data = new_wgts

model_en.transformer.set_input_embeddings(new_wte)

print(f'Portuguese wte matrix setup done!\n\nWe kept {len(same_tokens_list)} embeddings vectors from the English one.\nWe did not kept {len(different_tokens_list)} embeddings vectors from the English one (instead, we used the old wte mean vector).\n')

# Check identical tokens between the 2 vocabs

num = 15

print(f'{num} first tokens IN common between the 2 vocabs:\n{same_tokens_list[:num]}\n')

print(f'{num} first tokens NOT in common between the 2 vocabs:\n{different_tokens_list[:num]}')

Portuguese wte matrix setup done!

We kept 12948 embeddings vetors from the English one.

We did not kept 37309 embeddings vetors from the English one (we used the old wte mean vetor).

15 first tokens IN common between the 2 vocabs:

[('ĠQuit', 40195), ('Smith', 32470), ('Ġomit', 39040), ('oc', 574), ('ym', 18252), ('Ġactual', 9443), ('ck', 911), ('ĠPremier', 16558), ('Ġeste', 987), ('ĠInd', 3438), ('Ġbol', 4203), ('phen', 35836), ('ĠParticip', 36689), ('ĠZeus', 19316), ('Ġnan', 39770)]

15 first tokens NOT in common between the 2 vocabs:

[('PSDB', 23151), ('Ġenvio', 19270), ('Ġocupação', 5938), ('Ġdocumentada', 30011), ('Ġduros', 36706), ('visto', 44422), ('ĠSiro', 43061), ('Ġdestacavam', 47397), ('Ġarqui', 49060), ('ĠArte', 5977), ('ĠValor', 29721), ('Ġalinhados', 38446), ('Ġnúmeros', 4626), ('Ġpênis', 31686), ('cisa', 29710)]

Changing lm_head weights with the new embeddings matrix¶

model_en.lm_head.weight = model_en.transformer.wte.weight

model_en.lm_head

Linear(in_features=768, out_features=50257, bias=False)

5. Create fastai v2 Datasets and Dataloaders¶

5.1 fastai v2 Datasets¶

(text from Sylvain Gugger Transformers Tutorial) You can then group your data with this Transform using a TfmdLists. It has an s in its name because it contains the training and validation datasets.

We indicate the indices of the training dataset and the validation dataset with splits (here, 80% of the indices randomly chosen, then all the remaining indices).

lang = 'pt'

fname = f'all_texts_{lang}wiki.csv'

df = pd.read_csv(path_data/fname)

len(df)

203205

Sample (this allows us to quickly test our code)¶

- train: 80%

- val = 20%

df_sample = df[:1000]

num = int(0.8*len(df_sample))

idxs = np.random.randint(0, len(df_sample), len(df_sample))

idxs_train = idxs[:num]

idxs_val = idxs[num:]

We gather all texts in one numpy array (since it will be easier to use this way with fastai):

%%time

all_texts = np.concatenate([df_sample.iloc[idxs_train].text.values, df_sample.iloc[idxs_val].text.values])

CPU times: user 1.46 ms, sys: 218 µs, total: 1.68 ms Wall time: 1.61 ms

%%time

splits = [list(idxs_train), list(idxs_val)]

tls = TfmdLists(all_texts, TransformersTokenizer(tokenizer_pt), splits=splits, dl_type=LMDataLoader)

CPU times: user 322 ms, sys: 43.1 ms, total: 365 ms Wall time: 33.3 ms

We specify dl_type=LMDataLoader for when we will convert this TfmdLists to DataLoaders: we will use an LMDataLoader since we have a language modeling problem, not the usual fastai TfmdDL.

All data¶

- train: 80%

- val = 20%

# num = int(0.8*len(df))

# idxs = np.random.randint(0, len(df), len(df))

# idxs_train = idxs[:num]

# idxs_val = idxs[num:]

# save idxs train and valid

# torch.save(idxs_train, path_data/'idxs_train.pt')

# torch.save(idxs_val, path_data/'idxs_val.pt')

# load idxs train and valid

idxs_train = torch.load(path_data/'idxs_train.pt')

idxs_val = torch.load(path_data/'idxs_val.pt')

We gather all texts in one numpy array (since it will be easier to use this way with fastai):

%%time

all_texts = np.concatenate([df.iloc[idxs_train].text.values, df.iloc[idxs_val].text.values])

CPU times: user 42.6 ms, sys: 3.79 ms, total: 46.4 ms Wall time: 44.6 ms

%%time

splits = [list(idxs_train), list(idxs_val)]

tls = TfmdLists(all_texts, TransformersTokenizer(tokenizer_pt), splits=splits, dl_type=LMDataLoader)

CPU times: user 340 ms, sys: 31.9 ms, total: 372 ms Wall time: 151 ms

We specify dl_type=LMDataLoader for when we will convert this TfmdLists to DataLoaders: we will use an LMDataLoader since we have a language modeling problem, not the usual fastai TfmdDL.

5.2 fastai v2 Dataloaders¶

(text from Sylvain Gugger Transformers Tutorial) The fastai v2 library expects the data to be assembled in a DataLoaders object (something that has a training and validation dataloader). We can get one by using the dataloaders method. We just have to specify a batch size and a sequence length.

Since the GPT-2 model was trained with sequences of size 1024, we use this sequence length (it's a stateless model, so it will change the perplexity if we use less).

%%time

bs,sl = 8,1024

dls = tls.dataloaders(bs=bs, seq_len=sl)

CPU times: user 6h 43min 14s, sys: 59min 46s, total: 7h 43min Wall time: 31min 27s

%%time

# IMPOSSIBLE TO SAVE Dataloaders at the date of 07/01/2020

# source: https://forums.fast.ai/t/how-to-save-dataloaders/73828/6

# save

# fname = 'dls_ptwiki_tokenizerGPT2.pkl'

# torch.save(dls, path_data/fname)

# load

# dls = torch.load(path_data/fname)

CPU times: user 4 µs, sys: 1e+03 ns, total: 5 µs Wall time: 11 µs

6. Fine-tuning the model¶

(text from Sylvain Gugger Transformers Tutorial) The Hugging Face model will return a tuple in outputs, with the actual predictions and some additional activations (should we want to use them is some regularization scheme). To work inside the fastai training loop, we will need to drop those using a Callback: we use those to alter the behavior of the training loop.

Here we need to write the event after_pred and replace self.learn.pred (which contains the predictions that will be passed to the loss function) by just its first element. In callbacks, there is a shortcut that lets you access any of the underlying Learner attribute so we can write self.pred[0] instead of self.learn.pred[0]. That shorcut only works for read access, not write, so we have to write self.learn.pred on the right side (otherwise we would set a pred attribute in the Callback).

class DropOutput(Callback):

def after_pred(self): self.learn.pred = self.pred[0]

6.1 Splitter (get layers groups)¶

The model has 2 main layers groups: transformer and lm_head. As we can read in The illustrated GPT2, the lm_head is a copy of the embeddings matrix wte. Therefore, we need to split only the transformer layers group to get all layers.

We decided to follow the fine-tuning method showed in the notebook 10_nlp.ipynb by creating 4 layers groups: 3 layers groups of 4 decoder blocks and one embeddings groups with the wte and wpe matrices.

Split a GPT2 model in 4 groups for differential learning rates¶

def splitter(model):

"Split a GPT2 `model` in 3 groups for differential learning rates."

# First layers group : decoder blocks from 0 to 3

modules = []

for i in range(4): modules.append(model.transformer.h[i])

groups = [nn.Sequential(*modules)]

# Second layers group : decoder blocks from 4 to 7

modules = []

for i in range(4,8,1): modules.append(model.transformer.h[i])

groups = L(groups + [nn.Sequential(*modules)])

# Third layers group : decoder blocks from 8 to 11

modules = []

for i in range(8,12,1): modules.append(model.transformer.h[i])

groups = L(groups + [nn.Sequential(*modules)])

# Fourth layers group : embeddings matrices wte and wpe + LayerNorm at the model output

groups = L(groups + [nn.Sequential(model.transformer.wte,model.transformer.wpe,model.transformer.ln_f)])

return groups.map(params)

6.2 Learner¶

(text from Sylvain Gugger Transformers Tutorial) Now, we are ready to create our Learner, which is a fastai object grouping data, model and loss function and handles model training or inference. Since we are in a language model setting, we pass accuracy and perplexity as metrics, and we need to use the callback we just defined. Lastly, we use mixed precision to save every bit of memory we can (and if you have a modern GPU, it will also make training faster).

# Learner: basic class for handling the training loop

# source: https://dev.fast.ai/learner#Learner

learn = Learner(dls, model_en, loss_func=CrossEntropyLossFlat(),

splitter = splitter,

cbs=[DropOutput],

metrics=[accuracy, Perplexity()]).to_fp16()

We can check how good the model is without any fine-tuning step.

%%time

# loss, accuracy, Perplexity() of validation dataset

learn.validate()

CPU times: user 4h 45min 53s, sys: 1h 1min 36s, total: 5h 47min 30s Wall time: 53min 2s

(#3) [9.949938774108887,0.09898579120635986,20950.939453125]

- Loss = 9.95

- accuracy = 0.099

- perplexity = 20950.94

Now that we have a Learner, we will use during training all the fine-tuning techniques seen for classification model training (see the notebook 10_nlp.ipynb about "NLP Deep Dive: RNNs") to take advantage of the Transfer Learning of the GPT-2 pre-trained embeddings and model from Hugging Face Transformers:

- learning rate finder (method that helps finding the best learning rate to train the model)

- Mixed precision training (some of the operations will be done in FP16, others in FP32 in order to speed up the training)

- gradual unfreezing (the model has 4 layers groups created by our method

splitter: the embedding one and the 3 groups of 4 decoder blocks each) - 1cycle policy with the method fit_one_cycle() (The 1cycle policy was introduced by Leslie N. Smith et al. in Super-Convergence: Very Fast Training of Neural Networks Using Large Learning Rates. It schedules the learning rate with a cosine annealing from

lr_max/divtolr_maxthenlr_max/div_final(pass an array tolr_maxif you want to use differential learning rates) and the momentum with cosine annealing according to the values inmoms. The first phase takespct_startof the training. You can optionally pass additionalcbsandreset_opt.) - differential learning rates (each layers group with a learning rate different: the biggest one for the embeddings group, and the smallest one for the first 4 decoder blocks)

6.2.1 Freeze all layers but the last layers group (do not freeze wte, wpe embeddings matrices and last LayerNorm)¶

%%time

learn.freeze()

learn.lr_find()

CPU times: user 4min 21s, sys: 58.9 s, total: 5min 20s Wall time: 1min 5s

SuggestedLRs(lr_min=0.005754399299621582, lr_steep=2.2908675418875646e-06)

The learning rate finder curve suggests picking a lr min of 6e-3. Let's use 2e-3.

learn.fit_one_cycle(1, 2e-3)

| epoch | train_loss | valid_loss | accuracy | perplexity | time |

|---|---|---|---|---|---|

| 0 | 3.803344 | 3.640777 | 0.325177 | 38.121441 | 5:48:31 |

IOPub message rate exceeded. The notebook server will temporarily stop sending output to the client in order to avoid crashing it. To change this limit, set the config variable `--NotebookApp.iopub_msg_rate_limit`. Current values: NotebookApp.iopub_msg_rate_limit=1000.0 (msgs/sec) NotebookApp.rate_limit_window=3.0 (secs)

#hide

learn.recorder.plot_loss()

In just one epoch, our model passed

- from an accuracy of 9.90% to 32.52%

- from a perplexity of 20950.94 to 38.12

Not too bad!

Now, We can pass -2 to freeze_to to freeze all except the last two parameter groups.

learn.save(path_data/'GPT2_pt_1epoch_lr2e-3')

learn = learn.load(path_data/'GPT2_pt_1epoch_lr2e-3')

6.2.2 Freeze all layers but the last 2 layers groups¶

learn.freeze_to(-2)

learn.fit_one_cycle(1, slice(1e-3/(2.6**4),1e-3))

| epoch | train_loss | valid_loss | accuracy | perplexity | time |

|---|---|---|---|---|---|

| 0 | 3.453913 | 3.301886 | 0.362879 | 27.163816 | 5:38:18 |

#hide

learn.recorder.plot_loss()

learn.save(path_data/'GPT2_pt_2epoch_lr1e-3')

learn = learn.load(path_data/'GPT2_pt_2epoch_lr1e-3')

6.2.3 Freeze all layers but the last 3 layers groups¶

learn.freeze_to(-3)

learn.fit_one_cycle(1, slice(5e-4/(2.6**4),5e-4))

| epoch | train_loss | valid_loss | accuracy | perplexity | time |

|---|---|---|---|---|---|

| 0 | 3.333389 | 3.207390 | 0.374579 | 24.714487 | 6:20:51 |

#hide

learn.recorder.plot_loss()

learn.save(path_data/'GPT2_pt_3epoch_lr5e-4')

learn = learn.load(path_data/'GPT2_pt_3epoch_lr5e-4')

6.2.4 Unfreeze all layers¶

learn.unfreeze()

learn.fit_one_cycle(2, slice(1e-4/(2.6**4),1e-4))

| epoch | train_loss | valid_loss | accuracy | perplexity | time |

|---|---|---|---|---|---|

| 0 | 3.288433 | 3.186721 | 0.377380 | 24.208906 | 6:06:29 |

| 1 | 3.232569 | 3.167864 | 0.379885 | 23.756687 | 6:16:22 |

#hide

learn.recorder.plot_loss()

learn.save(path_data/'GPT2_pt_5epoch_lr1e-4_v2')

learn = learn.load(path_data/'GPT2_pt_5epoch_lr1e-4_v2')

Model sharing and uploading in the Hugging Face model hub¶

We can share our Portuguese GPT-2 on the Hugging Face model hub following the tutorial Model sharing and uploading.

Your model now has a page on huggingface.co/models 🔥

Anyone can load it from code:

tokenizer = AutoTokenizer.from_pretrained("namespace/awesome-name-you-picked")

model = AutoModel.from_pretrained("namespace/awesome-name-you-picked")

In our case, the code is:

from transformers import AutoTokenizer, AutoModelWithLMHead

tokenizer = AutoTokenizer.from_pretrained("pierreguillou/gpt2-small-portuguese")

model = AutoModelWithLMHead.from_pretrained("pierreguillou/gpt2-small-portuguese")

Check our Hugging face model page to get more information.

Text Generation by our Portuguese GPT-2¶

Now that we have a GPT-2 in Portuguese, we can use it for different tasks in NLP (Text Generation, Reading Comprehension, Translation, Summary) as showed in the post "GPT-2 use cases: beyond Text Generation".

For now, let's use it to generate new texts, which allows us to check that it works properly and also have a little fun.

Text Generation techniques¶

At each stage of text generation, GPT-2 provides a vector of 50.257 probabilities (each corresponds to a possible token of the vocabulary whose size is 50.257). To decide how to choose the output token from these probabilities, there are at least 5 methods: Greedy, Beam Search, Sampling with temperature, Top-k sampling and Top-p (nucleus) sampling.

In this tutorial, we will test only 2 of these text generation methods: Top-k sampling and Top-p (nucleus) sampling.

Note: to get more information on text generation techniques for transformer-based language model, read the article "How to generate text: using different decoding methods for language generation with Transformers" from Patrick von Platen (Hugging Face, 03/18/2020).

(Use case 1) Top-k sampling¶

Our use case 1 follows the same method used by OpenAI in page 20 of the paper Language Models are Unsupervised Multitask Learners by choosing Top-k sampling text generation technique with a value of 40.

This text generation method is implemented in the model.generate() function of a Transformers model thanks to the following arguments:

top_k(int): the number of highest probability vocabulary tokens to keep for top-k-filtering. Between 1 and infinity. Default to 50.

(Use case 2) Top-p (nucleus) sampling¶

Our use case 2 follows the top-p (nucleus) sampling method with Top-p sampling (top_p = 0.95), top-k sampling (top_k = 50), temperature (temperature = 0.7) and repetition penalty (repetition_penalty = 1.2).

This text generation method is implemented in the model.generate() function of a Transformers model thanks to the following arguments:

top_p(float): the cumulative probability of parameter highest probability vocabulary tokens to keep for nucleus sampling. Must be between 0 and 1. Default to 1.top_k(int): the number of highest probability vocabulary tokens to keep for top-k-filtering. Between 1 and infinity. Default to 50.temperature(float): the value used to module the next token probabilities. Must be strictly positive. Default to 1.0.repetition_penalty(float): the parameter for repetition penalty. Between 1.0 and infinity. 1.0 means no penalty. Default to 1.0.

Text n°1 | Famous OpenAI generated text about unicorns¶

At the time of publication of GPT-2 in the article "Better Language Models and Their Implications" (02/14/2019), the media retained from its different possibilities in NLP that of text generation because of the now famous text generated on unicorns from this small paragraph:

In a shocking finding, scientist discovered a herd of unicorns living in a remote, previously unexplored valley, in the Andes Mountains. Even more surprising to the researchers was the fact that the unicorns spoke perfect English.

From this text, GPT-2 wrote the following sample out of 10 tries:

openai_generated_text_en = "In a shocking finding, scientist discovered a herd of unicorns living in a remote, previously unexplored valley, in the Andes Mountains. Even more surprising to the researchers was the fact that the unicorns spoke perfect English. \

\n\nThe scientist named the population, after their distinctive horn, Ovid's Unicorn. These four-horned, silver-white unicorns were previously unknown to science. \

\n\nNow, after almost two centuries, the mystery of what sparked this odd phenomenon is finally solved. \

\n\nDr. Jorge Pérez, an evolutionary biologist from the University of La Paz, and several companions, were exploring the Andes Mountains when they found a small valley, with no other animals or humans. Pérez noticed that the valley had what appeared to be a natural fountain, surrounded by two peaks of rock and silver snow. \

\n\nPérez and the others then ventured further into the valley. “By the time we reached the top of one peak, the water looked blue, with some crystals on top,” said Pérez. \

\n\nPérez and his friends were astonished to see the unicorn herd. These creatures could be seen from the air without having to move too much to see them – they were so close they could touch their horns. \

\n\nWhile examining these bizarre creatures the scientists discovered that the creatures also spoke some fairly regular English. Pérez stated, “We can see, for example, that they have a common ‘language,’ something like a dialect or dialectic.” \

\n\nDr. Pérez believes that the unicorns may have originated in Argentina, where the animals were believed to be descendants of a lost race of people who lived there before the arrival of humans in those parts of South America. \

\n\nWhile their origins are still unclear, some believe that perhaps the creatures were created when a human and a unicorn met each other in a time before human civilization. According to Pérez, “In South America, such incidents seem to be quite common.” \

\n\nHowever, Pérez also pointed out that it is likely that the only way of knowing for sure if unicorns are indeed the descendants of a lost alien race is through DNA. “But they seem to be able to communicate in English quite well, which I believe is a sign of evolution, or at least a change in social organization,” said the scientist."

print(openai_generated_text_en)

In a shocking finding, scientist discovered a herd of unicorns living in a remote, previously unexplored valley, in the Andes Mountains. Even more surprising to the researchers was the fact that the unicorns spoke perfect English. The scientist named the population, after their distinctive horn, Ovid's Unicorn. These four-horned, silver-white unicorns were previously unknown to science. Now, after almost two centuries, the mystery of what sparked this odd phenomenon is finally solved. Dr. Jorge Pérez, an evolutionary biologist from the University of La Paz, and several companions, were exploring the Andes Mountains when they found a small valley, with no other animals or humans. Pérez noticed that the valley had what appeared to be a natural fountain, surrounded by two peaks of rock and silver snow. Pérez and the others then ventured further into the valley. “By the time we reached the top of one peak, the water looked blue, with some crystals on top,” said Pérez. Pérez and his friends were astonished to see the unicorn herd. These creatures could be seen from the air without having to move too much to see them – they were so close they could touch their horns. While examining these bizarre creatures the scientists discovered that the creatures also spoke some fairly regular English. Pérez stated, “We can see, for example, that they have a common ‘language,’ something like a dialect or dialectic.” Dr. Pérez believes that the unicorns may have originated in Argentina, where the animals were believed to be descendants of a lost race of people who lived there before the arrival of humans in those parts of South America. While their origins are still unclear, some believe that perhaps the creatures were created when a human and a unicorn met each other in a time before human civilization. According to Pérez, “In South America, such incidents seem to be quite common.” However, Pérez also pointed out that it is likely that the only way of knowing for sure if unicorns are indeed the descendants of a lost alien race is through DNA. “But they seem to be able to communicate in English quite well, which I believe is a sign of evolution, or at least a change in social organization,” said the scientist.

Reload Portuguese GPT-2¶

English pre-trained GPT-2¶

%%time

from transformers import GPT2TokenizerFast, GPT2LMHeadModel

pretrained_weights = 'gpt2'

tokenizer_en = GPT2TokenizerFast.from_pretrained(pretrained_weights)

model_en = GPT2LMHeadModel.from_pretrained(pretrained_weights)

Some weights of GPT2LMHeadModel were not initialized from the model checkpoint at gpt2 and are newly initialized: ['h.0.attn.masked_bias', 'h.1.attn.masked_bias', 'h.2.attn.masked_bias', 'h.3.attn.masked_bias', 'h.4.attn.masked_bias', 'h.5.attn.masked_bias', 'h.6.attn.masked_bias', 'h.7.attn.masked_bias', 'h.8.attn.masked_bias', 'h.9.attn.masked_bias', 'h.10.attn.masked_bias', 'h.11.attn.masked_bias', 'lm_head.weight'] You should probably TRAIN this model on a down-stream task to be able to use it for predictions and inference.

CPU times: user 14.4 s, sys: 1.8 s, total: 16.2 s Wall time: 7.72 s

Portuguese tokenizer¶

from transformers import GPT2TokenizerFast

# Get the path to ByteLevelBPE_tokenizer_pt config files

ByteLevelBPE_tokenizer_pt_rep = 'ByteLevelBPE_tokenizer_pt'

path_to_ByteLevelBPE_tokenizer_pt_rep = path_data/ByteLevelBPE_tokenizer_pt_rep

# import the pre-trained GPT2TokenizerFast tokenizer with the tokenizer_pt config files

tokenizer_pt = GPT2TokenizerFast.from_pretrained(

str(path_to_ByteLevelBPE_tokenizer_pt_rep),

pad_token='<|endoftext|>')

# Get sequence length max of 1024

tokenizer_pt.model_max_length = 1024

Datasets¶

class TransformersTokenizer(Transform):

def __init__(self, tokenizer): self.tokenizer = tokenizer

def encodes(self, x):

toks = self.tokenizer.tokenize(x)

return tensor(self.tokenizer.convert_tokens_to_ids(toks))

def decodes(self, x): return TitledStr(self.tokenizer.decode(x.cpu().numpy()))

# get data

lang = 'pt'

fname = f'all_texts_{lang}wiki.csv'

df = pd.read_csv(path_data/fname)

# load idxs train and valid

idxs_train = torch.load(path_data/'idxs_train.pt')

idxs_val = torch.load(path_data/'idxs_val.pt')

all_texts = np.concatenate([df.iloc[idxs_train].text.values, df.iloc[idxs_val].text.values])

splits = [list(idxs_train), list(idxs_val)]

tls = TfmdLists(all_texts, TransformersTokenizer(tokenizer_pt), splits=splits, dl_type=LMDataLoader)

Dataloaders¶

%%time

bs,sl = 8,1024

dls = tls.dataloaders(bs=bs, seq_len=sl)

CPU times: user 27min 56s, sys: 3min 20s, total: 31min 16s Wall time: 25min 8s

Split a GPT2 model in 4 groups for differential learning rates¶

class DropOutput(Callback):

def after_pred(self): self.learn.pred = self.pred[0]

def splitter(model):

"Split a GPT2 `model` in 3 groups for differential learning rates."

# First layers group : decoder blocks from 0 to 3

modules = []

for i in range(4): modules.append(model.transformer.h[i])

groups = [nn.Sequential(*modules)]

# Second layers group : decoder blocks from 4 to 7

modules = []

for i in range(4,8,1): modules.append(model.transformer.h[i])

groups = L(groups + [nn.Sequential(*modules)])

# Third layers group : decoder blocks from 8 to 11

modules = []

for i in range(8,12,1): modules.append(model.transformer.h[i])

groups = L(groups + [nn.Sequential(*modules)])

# Fourth layers group : embeddings matrices wte and wpe + LayerNorm at the model output

groups = L(groups + [nn.Sequential(model.transformer.wte,model.transformer.wpe,model.transformer.ln_f)])

return groups.map(params)

Learner¶

# Learner: basic class for handling the training loop

# source: https://dev.fast.ai/learner#Learner

learn = Learner(dls, model_en, loss_func=CrossEntropyLossFlat(),

splitter = splitter,

cbs=[DropOutput],

metrics=[accuracy, Perplexity()]).to_fp16()

learn = learn.load(path_data/'GPT2_pt_5epoch_lr1e-4_v2')

# model

model_pt = learn.model

# put model into eval mode and on GPU

model_pt.eval();

model_pt.to('cuda');

Get translated famous unicorn text in Portuguese¶

from transformers import MarianMTModel, MarianTokenizer

# MarianMT Translator

model_name = 'Helsinki-NLP/opus-mt-en-ROMANCE'

tokenizer_en_pt = MarianTokenizer.from_pretrained(model_name)

print(tokenizer_en_pt.supported_language_codes)

model_en_pt = MarianMTModel.from_pretrained(model_name)

['>>fr<<', '>>es<<', '>>it<<', '>>pt<<', '>>pt_br<<', '>>ro<<', '>>ca<<', '>>gl<<', '>>pt_BR<<', '>>la<<', '>>wa<<', '>>fur<<', '>>oc<<', '>>fr_CA<<', '>>sc<<', '>>es_ES<<', '>>es_MX<<', '>>es_AR<<', '>>es_PR<<', '>>es_UY<<', '>>es_CL<<', '>>es_CO<<', '>>es_CR<<', '>>es_GT<<', '>>es_HN<<', '>>es_NI<<', '>>es_PA<<', '>>es_PE<<', '>>es_VE<<', '>>es_DO<<', '>>es_EC<<', '>>es_SV<<', '>>an<<', '>>pt_PT<<', '>>frp<<', '>>lad<<', '>>vec<<', '>>fr_FR<<', '>>co<<', '>>it_IT<<', '>>lld<<', '>>lij<<', '>>lmo<<', '>>nap<<', '>>rm<<', '>>scn<<', '>>mwl<<']

src_text = [

'>>pt_BR<< In a shocking finding, scientist discovered a herd of unicorns living in a remote, previously unexplored valley, in the Andes Mountains. Even more surprising to the researchers was the fact that the unicorns spoke perfect English.',

]

print(src_text)

['>>pt_BR<< In a shocking finding, scientist discovered a herd of unicorns living in a remote, previously unexplored valley, in the Andes Mountains. Even more surprising to the researchers was the fact that the unicorns spoke perfect English.']

translated = model_en_pt.generate(**tokenizer_en_pt.prepare_translation_batch(src_text))

tgt_text = [tokenizer_en_pt.decode(t, skip_special_tokens=True) for t in translated]

prompt = tgt_text[0]

prompt

'Num achado chocante, o cientista descobriu uma manada de unicórnios vivendo num vale remoto, anteriormente inexplorado, nas Montanhas dos Andes. Ainda mais surpreendente para os pesquisadores foi o fato de que os unicórnios falavam inglês perfeito.'

Get generated text¶

# Get the number of tokens of the OpenAI English generated text

openai_generated_text_en = "In a shocking finding, scientist discovered a herd of unicorns living in a remote, previously unexplored valley, in the Andes Mountains. Even more surprising to the researchers was the fact that the unicorns spoke perfect English. \

\n\nThe scientist named the population, after their distinctive horn, Ovid's Unicorn. These four-horned, silver-white unicorns were previously unknown to science. \

\n\nNow, after almost two centuries, the mystery of what sparked this odd phenomenon is finally solved. \

\n\nDr. Jorge Pérez, an evolutionary biologist from the University of La Paz, and several companions, were exploring the Andes Mountains when they found a small valley, with no other animals or humans. Pérez noticed that the valley had what appeared to be a natural fountain, surrounded by two peaks of rock and silver snow. \

\n\nPérez and the others then ventured further into the valley. “By the time we reached the top of one peak, the water looked blue, with some crystals on top,” said Pérez. \

\n\nPérez and his friends were astonished to see the unicorn herd. These creatures could be seen from the air without having to move too much to see them – they were so close they could touch their horns. \

\n\nWhile examining these bizarre creatures the scientists discovered that the creatures also spoke some fairly regular English. Pérez stated, “We can see, for example, that they have a common ‘language,’ something like a dialect or dialectic.” \

\n\nDr. Pérez believes that the unicorns may have originated in Argentina, where the animals were believed to be descendants of a lost race of people who lived there before the arrival of humans in those parts of South America. \

\n\nWhile their origins are still unclear, some believe that perhaps the creatures were created when a human and a unicorn met each other in a time before human civilization. According to Pérez, “In South America, such incidents seem to be quite common.” \

\n\nHowever, Pérez also pointed out that it is likely that the only way of knowing for sure if unicorns are indeed the descendants of a lost alien race is through DNA. “But they seem to be able to communicate in English quite well, which I believe is a sign of evolution, or at least a change in social organization,” said the scientist."

openai_generated_text_en_ids = tokenizer_en.encode(openai_generated_text_en, return_tensors='pt').to('cuda')

max_length = openai_generated_text_en_ids.shape[1]

print(max_length)

504

# encode

input_ids = tokenizer_pt.encode(prompt, return_tensors='pt').to('cuda')

Use case 1 (Top-k sampling)¶

%%time

#set top_k = 40 and num_return_sequences = 3

sample_outputs = model_pt.generate(input_ids, pad_token_id=50256,

do_sample=True,

max_length=max_length,

min_length=max_length,

top_k=40,

num_return_sequences=3)

for i, sample_output in enumerate(sample_outputs):

print(">> Generated text {}\n\n{}".format(i+1, tokenizer_pt.decode(sample_output.tolist())))

print('\n---')

>> Generated text 1 Num achado chocante, o cientista descobriu uma manada de unicórnios vivendo num vale remoto, anteriormente inexplorado, nas Montanhas dos Andes. Ainda mais surpreendente para os pesquisadores foi o fato de que os unicórnios falavam inglês perfeito. Um deles, um escocês chamado Thomas (um anatomista irlandês) que havia trabalhado com o britânico em seu trabalho como assistente do diretor experimental da universidade, John Holley, foi chamado de por eles para um encontro sobre os dois conceitos, que não tinham encontrado muito trabalho até o momento. Eles foram palestrantes, mas ficaram impressionados que Thomas (como todos os outros cientistas da época) não sabia falar Inglês. Quando Thomas fez isso com os unicórnios por engano, Holley a escreveu e enviou um telegrama à BBC perguntando: ""Tão, o que é tal dizer se você quer saber de nenhum outro, eu não sei como ele fala inglês?"" Eles disseram a ele: "Não, mas é um idiota." Então, uma semana depois, no mesmo dia, Holley o enviou, uma carta com um questionário para os membros do elenco de ""Doctor Who"". Thomas, como qualquer um dos cientistas mencionados, não se lembra muito bem dos eventos que aconteceram em Londres. Depois do segundo episódio, o editor-produtor Michael Gambon deu o que ele achou que valia, então disse: "Vamos fazer um comentário, para o elenco e equipe deDoctor Who." Como resultado, eles deram permissão para que eles assistissem outro episódio. Isto foi o suficiente para que "The Magician" aparecesse para o cânone da BBC. Na segunda temporada, "The Magician" teve um episódio chamado "The End of the World", e o ator John Huston, que interpreta John Watson, era o mais conhecido ator inglês do programa. "The End of the World" foi ao ar em 13 de outubro de 2000. A BBC anunciou que "The Magician" seria exibida ao vivo em janeiro de 2003 da HBO em 15 de janeiro de 2003. Ele também foi transmitido na televisão em 16 de janeiro de 2004 da BBC One, em uma transmissão que também marcou o cancelamento de um episódio. A série é uma produção da BBC-NBC Television Limited. Ela foi produzida por Paul Rudd, John Swarns e Jonathan Seagal e foi criada por David Tennant, Graham Hill, Colin Smith, Tom Baker, Jack Davies e Paul Thompson. O primeiro episódio foi exibido em 17 de outubro de --- >> Generated text 2 Num achado chocante, o cientista descobriu uma manada de unicórnios vivendo num vale remoto, anteriormente inexplorado, nas Montanhas dos Andes. Ainda mais surpreendente para os pesquisadores foi o fato de que os unicórnios falavam inglês perfeito. "Não é mais estranho que a nossa forma tivesse o inglês com dois de suas asas como se o macho fosse inglês — o que é interessante. Mas a sua natureza inata seria estranha para o inglês", acredita eles. Em 2015, cientistas realizaram uma nova análise sobre as formas dos unicórnios. De acordo com especialistas na área, os membros superiores do grupo foram provavelmente derivados de outra espécie de escorpião — uma espécie com características semelhantes. Uma nova equipe de cientistas calculou que uma fêmea unicornada da Eurásia seria originalmente uma humana. "Isto significa que o ancestral do unicórnio, um híbrido de um esquilo e um escorpião macho não nasceu. Um estudo recente estimou que cerca de 12% do corpo humano é composto por membros de qualquer um dos grupos mais diverso de animais extintos, incluindo o ser humano e o unicórnio-do-sul. "A análise dos dados mostra que a maioria dos membros do gênero é composta por um exito e um exito macho que compartilham uma única espécie de corpo. Em alguns casos, estes membros compartilham um mesmo conjunto (a linhagem) de partes em dois espécimes." O estudo indica que os membros de "P. rubi" são semelhantes em aparência e morfologia aos membros humanos modernos, como as fêmeas modernas e machos robustos. "Como é evidente com os membros de "P. rubi", os ancestrais e o ancestral eram similares na forma e na composição das semelhanças em um organismo." O DNA do "P. rubi," chamado por sua forma em inglês de "sonoroplasto", revela que o "sonoroplasto" inclui três genes de alto nível e quatro genes relativamente reduzidos (e ausentes) e um gene de baixo nível (e ausentes) com uma concentração de cloroplasto em cada núcleo. A "sonoroplasto" se assemelha à "P. rubi" em características morfológicas e comportamentais, embora as diferenças na morfologia sejam menores. "A espécie "P. rubi" apresenta cinco pares de cromossomos separados (com 6 pares se aproximando e 8 pares se afastando) e um "sonoroplasto de base" (com 12 pares se aproximando e 15 pares se afastando), sugerindo que o membro tenha uma composição semelhante ao ancestral "P. rubi --- >> Generated text 3 Num achado chocante, o cientista descobriu uma manada de unicórnios vivendo num vale remoto, anteriormente inexplorado, nas Montanhas dos Andes. Ainda mais surpreendente para os pesquisadores foi o fato de que os unicórnios falavam inglês perfeito. O jogo de corrida da FIAT foi introduzido no Salão Internacional de FIAT (em 1989) em um evento que teve como principal objetivo fornecer uma oportunidade a todos que competirem em corridas de carros nacionais, como as categorias de base e pilotos. Esse evento trouxe o título de "National Le Mans Series" (1973), além de um terceiro título que o vencedor da competição ganharia. O primeiro campeonato foi disputado entre 1983 e 1985, e foi vencido pelo piloto estadunidense Dennis Young. O Campeonato de Le Mans foi criado por uma equipa formada em 1983 na rua General Motors, em Long Beach, Califórnia, e patrocinado pela "Frampton Racing", criada pelo empresário de corridas do Reino Unido Derek J. Cox, e é atualmente patrocinado pela equipe da equipe de Fórmula 1 da Ferrari, Lotus e McLaren, "Lusa Motorsports" e pela equipe de corrida britânica Team Lotus. "Lusa" foi fundada como uma "casa", mas a companhia não conseguiu competir em corridas por cinco anos devido à falta de patrocinador, e os pilotos que competiram em Lusa foram proibidos de pilotar a equipe McLaren em 1997. A equipe mudou seu nome para Lusa Motorsports em 1999. As corridas de Fórmula 1 só foram retomadas duas vezes por falta de patrocinadores, no começo de 2000, e novamente em 2003 por "franqueza". Em 2003, a Williams-Renault obteve o seu primeiro título da temporada, uma corrida de Le Mans de estilo "Grand Prix", em que os carros eram todos monopostos, mas com carros "primo", mais do que os carros de Fórmula 1. A temporada de 2003 teve muitas modificações em termos de desempenho, como novos pneus e mudanças na configuração dos carros, e foi a sexta temporada do campeonato do campeonato com mais pontos no campeonato na temporada de 2004, com cinco vitórias no campeonato, três na temporada de 2008 e cinco na de 2009. Em 2005, a Toyota assinou um contrato exclusivo para a produção de veículos para a Temporada de Le Mans e o primeiro ano em que a equipe Toyota foi a primeira equipe a ser a primeira a dar uma vitória ao correr "Le Mans Series", uma prova de Fórmula 1, na qual a equipe Toyota produziu dois carros da temporada. Apesar de ter vencido a prova, foi a --- CPU times: user 7.77 s, sys: 372 ms, total: 8.15 s Wall time: 8.16 s

Use case 2 (Top-p nucleus sampling)¶

%%time

#set top_p = 0.95, top_k = 50, temperature = 0.7, repetition_penalty = 1.2 and num_return_sequences = 3

sample_outputs = model_pt.generate(input_ids, pad_token_id=50256,

do_sample=True,

max_length=max_length,

min_length=max_length,

repetition_penalty=1.2,

temperature=0.7,

top_k=50,

top_p=0.95,

num_return_sequences=3)

for i, sample_output in enumerate(sample_outputs):

print(">> Generated text {}\n\n{}".format(i+1, tokenizer_pt.decode(sample_output.tolist())))

print('\n---')

>> Generated text 1

Num achado chocante, o cientista descobriu uma manada de unicórnios vivendo num vale remoto, anteriormente inexplorado, nas Montanhas dos Andes. Ainda mais surpreendente para os pesquisadores foi o fato de que os unicórnios falavam inglês perfeito. Eles não sabiam onde exatamente eram falantes nativos do idioma, e acreditaram que eles simplesmente migraram das terras altas da região de Mendoza ao norte como consequência do declínio populacional que ocorreu na Cordilheira das Cobras.

Em 2004, o Departamento de Antropologia da Universidade do Colorado anunciou que havia encontrado uma fêmea no vale do rio Orinoco na Bolívia, mas essa fêmea foi morta durante a investigação. No entanto, no início de 2006, as autoridades locais anunciaram que havia identificado uma fêmea encontrada em uma área próxima à Cordilheira dos Andes, no Vale do Cauca. A equipe de pesquisadores relatou que esta fêmea era chamada de "El Maria" ou "El Maria".

O estudo revelou que o grupo de unicórnios habitava um ecossistema bastante diverso, com espécies endêmicas incluindo espécies como as tiláceas gigantescas (que são encontradas principalmente nos países subdesenvolvidos) e as quelupus ("Erica azoricae").

Um dos principais objetivos do estudo da espécie é determinar se os europeus teriam colonizado a região entre a década de 1940 e 1960 e se estes últimos grupos étnicos sobreviveram até hoje. Os cientistas acreditam que as populações desses grupos poderiam ter sido muito maiores antes disso; por exemplo, a teoria sugere que a população europeia provavelmente teria introduzido os humanos primitivos na América Central depois que os espanhóis invadiram a região, embora isso seja controverso.

O gênero "El Maria" tem um ancestral comum, os "Looney-do-the-Bone", um pequeno grupo de "Looney-da-Daíndia" encontrados apenas no leste dos Estados Unidos, Canadá e México. O gênero possui parentesco próximo ao gênero "Lontrapyrus", também conhecido como lontras negras. Acredita-se que esses indivíduos tenham migrado para o leste dos Andes, atravessando regiões montanhosas do sul de América Central e América Central.

Os membros desta família são geralmente confundidos com os lontras brancos.

As fêmeas têm cerca de seis centímetros de comprimento, pesando de 9 quilogramas e medindo 11 cm de largura. A cabeça é branca, com manchas escuras pretas escuras sobre seus flancos. As patas posteriores podem ser amarelas, enquanto sua cauda pode estar preta ou branca, dependendo da cor utilizada na identificação. As costas apresentam quatro dedos dorsais bem desenvolvidas

---

>> Generated text 2

Num achado chocante, o cientista descobriu uma manada de unicórnios vivendo num vale remoto, anteriormente inexplorado, nas Montanhas dos Andes. Ainda mais surpreendente para os pesquisadores foi o fato de que os unicórnios falavam inglês perfeito.

O fóssil é encontrado no Vale de La Guaira, na região de San Juan, com cerca de 1 metro (1,8 m) de comprimento e cerca de 4 metros (2 pés) de largura, em Wyoming. A cabeça possui cinco dedos no pé direito e duas garras direita. No topo do crânio há quatro placas pretas-escuros. O cérebro tem um formato triangular, a base apresenta apenas uma pequena porção da metade anterior e três partes do pescoço são pretos-claro; a face tem um tom vermelho escuro-escuro. A mandíbula também contém oito pares de maxilas bem desenvolvidas.

A região de San Juan foi descoberta por volta de 14 mil anos atrás. Foi escavado durante a Guerra dos Sete Anos e tem aproximadamente 6 metros quadrados de espessura. O local era habitado pelo povo de Tacuareña, que vivia entre o final do e o início do e tinha uma cultura diferente das outras regiões próximas ao território de El Berriol. Os indígenas não eram caçadores conhecidos pelos nativos e como "carijós".

O fóssil foi descoberto em 2002 e depois enviado para uma equipe de arqueólogos liderada pela Universidade de Wyoming. A equipe encontrou os restos humanos e o chamou de "caçadores" ou "coletores", pois eles tinham sido mortos pelas expedições anteriores ao assentamento.

O arqueólogo Brian C. Fanning, da Universidade de Wyoming, fez várias entrevistas com os esqueletos humanos e descobriram os crânios de dois ou três homens que foram enterrados em um túmulo localizado abaixo do túmulo de um antigo homem chamado Huehue, que estava enterrado por volta de 10500 anos atrás. O homem que estava enterrado é o membro de um grupo étnico conhecido como "Huehue".

A equipe de pesquisadores da equipe de Fanning incluiu a presença humana no local onde o homem enterrado, incluindo um cemitério indígena que está próximo à entrada do cemitério. Eles encontraram evidências ósseas humanas enterradas perto dos ossos do homem e outros artefatos encontrados dentro de um depósito de ossos de um homem chamado "Creator".

Os pesquisadores acharam vários ossos humanos semelhantes aos ossos de Huehue, mas sem as marcas físicas. Eles notaram semelhanças anatômicas entre esses membros de um grupo étnico chamado "Caçadores", possivelmente porque ambos viviam no Vale de

---

>> Generated text 3

Num achado chocante, o cientista descobriu uma manada de unicórnios vivendo num vale remoto, anteriormente inexplorado, nas Montanhas dos Andes. Ainda mais surpreendente para os pesquisadores foi o fato de que os unicórnios falavam inglês perfeito.

Os arqueólogos descobriram um conjunto de moedas cunhadas por indígenas e outros achados arqueológicos encontrados no local durante as escavações foram feitos ao longo da década de 1960 em um esforço de resgate arqueológica e reconhecimento pela população indígena.

O achado arqueológico é o único relato sobre a cultura do gênero "Saccharus", que se refere às culturas terrestres primitivas não relacionadas com o "Homo sapiens".

A pesquisa envolveu cerca de 60 anos de escavação, incluindo levantamento topográfico efetuado entre 1972 e 1977. Em 1988, o arqueólogo americano John Deere, que pesquisou as ruínas do complexo arqueológico do Monte dos Andes, observou que a cultura deste gênero estava fortemente relacionada com outras civilizações mesoamericanas, como o olmeca e a olmeca.

O arqueólogo franco-americano John Deere observou que a cultura desses gêneros era bem próxima à civilização olmeca e "a cultura dos astecas" foi muito similar àquelas encontradas na América Central em seus sítios prévios.

Em 1991, o arqueólogo americano John Deere publicou uma extensa monografia descrevendo a cultura dos Andes. Ele escreveu:

Muitos estudiosos têm alegado que a cultura dos Andes pode ter sido transmitida através de migrações humanas do continente americano. Contudo, estudos recentes, baseados nos dados históricos obtidos em diferentes lugares dos Andes sugerem que tais migrações ocorreram antes ou imediatamente após as primeiras invasões americanas de europeus.

Pesquisas iniciais demonstraram que esta migração ocorreu provavelmente entre o final do século XVIII e meados do século XIX, quando sociedades modernas dominavam o solo chileno, Peru, Bolívia e Colômbia. As tribos inca e xamãs também estavam envolvidas nesta atividade.

A história das Américas começou em torno de um grupo de caçadores sulamericanos pertencentes aos Andes liderados pelo índio A. Iruña, que estabeleceu sua capital no atual assentamento chamado "San Juan del Sur". Acreditava-se que ele teria fundado um assentamento que seria conhecido por sua fama de ser capaz de caçar com seus guerreiros e construir suas casas com o passar do tempo.

Durante o século XVIII, as terras baixas eram propícias para o crescimento populacional e, consequentemente, o desenvolvimento econômico das novas cidades situadas em torno delas.

Os primeiros exploradores espanhóis chegaram ao Novo Mundo em 1692 e estabeleceram assentamentos permanentes nesses territórios até a década de 1830. As tentativas espanholas

---

CPU times: user 35.3 s, sys: 1.85 s, total: 37.2 s

Wall time: 37.2 s

Text n°2 | Recent text on the coronavirus disease (Covid-19)¶

# source (uol, 07/13/2020): https://www.uol.com.br/vivabem/noticias/redacao/2020/07/13/russia-vacina-conclui-testes-distribuicao-em-agosto.htm

prompt = "A Rússia está mais perto de se tornar o primeiro país a iniciar a distribuição de uma vacina contra o coronavírus para a população. O país anunciou hoje que concluiu parte dos testes clínicos necessários para comprovar a eficácia da imunização desenvolvida por iniciativa do governo russo. A expectativa é de que a distribuição comece já em agosto."

print(prompt)

A Rússia está mais perto de se tornar o primeiro país a iniciar a distribuição de uma vacina contra o coronavírus para a população. O país anunciou hoje que concluiu parte dos testes clínicos necessários para comprovar a eficácia da imunização desenvolvida por iniciativa do governo russo. A expectativa é de que a distribuição comece já em agosto.

# encode

input_ids = tokenizer_pt.encode(prompt, return_tensors='pt').to('cuda')

Use case 1 (Top-k sampling)¶

%%time

#set top_k = 40 and num_return_sequences = 3

sample_outputs = model_pt.generate(input_ids, pad_token_id=50256,

do_sample=True,

max_length=max_length,

min_length=max_length,

top_k=40,

num_return_sequences=3)

for i, sample_output in enumerate(sample_outputs):

print(">> Generated text {}\n\n{}".format(i+1, tokenizer_pt.decode(sample_output.tolist())))

print('\n---')

>> Generated text 1 A Rússia está mais perto de se tornar o primeiro país a iniciar a distribuição de uma vacina contra o coronavírus para a população. O país anunciou hoje que concluiu parte dos testes clínicos necessários para comprovar a eficácia da imunização desenvolvida por iniciativa do governo russo. A expectativa é de que a distribuição comece já em agosto. Entre os primeiros casos confirmados de COVID-19 na Rússia estava um homem russo com idade entre 50 e 49 anos, segundo o jornal " Moscow" e o primeiro caso em 28 de fevereiro, a primeira no Hospital Pulkai. No entanto, os primeiros casos foram mais sérios devido sua "maturidade sem gravidade" e a falta de uma pessoa estar disponível para testes de suas condições de vida. Entre os pacientes que foram considerados estão funcionários de um hospital ou enfermeiros na cidade de Moscou (ver abaixo) ou médicos. Depois de serem testados negativos após um teste positivo, o paciente se recupera completamente. Os russos também anunciaram que serão realizados testes de coronavírus de outros países, como a França, que inicialmente acreditava que os vírus da gripe tinham sido transmitido pela Europa (a expectativa é de 20 a 50 casos por dia). A situação foi resolvida em 24 de fevereiro, quando o Ministério da Saúde confirmou sua conclusão de que a COVID-19 é transmitida de via aérea. Até ao dia do seu primeiro caso, a Rússia tinha o menor número de funcionários e médicos com doença grave antes de o vírus ter se tornado um vírus no país. Os números de funcionários com doença grave não chegaram a ser confirmados, segundo o Ministério da Saúde, devido a sua falta de apoio. O vírus que está em curso no país é transmitido pela primeira vez nos Estados Unidos, onde foi isolado em 14 de fevereiro. Em Portugal o Ministério dos Negócios Estrangeiros declarou oficialmente em 11 de fevereiro que a COVID-19 está presente no país, mas não anunciou nenhum impacto na prática. No entanto, o Ministério do Trabalho declarou no dia seguinte que o coronavírus existe "em todo os países que não têm regulamentação" e que nenhum "aedes", que era identificado em 11 de fevereiro, tinha entrado na corrente sanguínea. Em 9 de março, autoridades russas confirmaram que o paciente não está hospitalizado e que está em quarentena no Hospital Pulkai. Mais dois casos de COVID-19 foram anunciados em 9 de março, mas foram considerados casos de "propaganda" e não de risco. Em 9 de maio, autoridades russas confirmaram os confirmados em todo país. Em 10 de maio, --- >> Generated text 2 A Rússia está mais perto de se tornar o primeiro país a iniciar a distribuição de uma vacina contra o coronavírus para a população. O país anunciou hoje que concluiu parte dos testes clínicos necessários para comprovar a eficácia da imunização desenvolvida por iniciativa do governo russo. A expectativa é de que a distribuição comece já em agosto. As populações de Wuhan, Wuhan, Qinghai, Shenzhen na costa oeste do China e no norte de Xangai, na província de Hubei, e os subúrbios da cidade de Tvershend em Hong Kong já estão de acordo com o número de casos confirmados. Uma nova equipe de infecologistas para ajudar a determinar os possíveis efeitos da pandemia já está em Xangai. Em 14 de março, a Rússia também tem a oportunidade de testar novas vacinas virais e testar novas versões para garantir a propagação de maisvírus na China através da transmissão de novos coronavírus. As autoridades russas e autoridades de saúde chinesas têm se preparado para assumir essa atitude de emergência com base nos dados coletados pela máscaras, máscaras de voo e máscaras faciais. Um relatório de uma empresa francesa informou que mais de 30 pessoas morreram na área de transmissão ao longo do mês de março, em relação aos dois primeiros casos. Em 21 de março, mais de 2,3 milhões de pessoas foram afetadas em áreas urbanas. Segundo o Conselho de Saúde, cerca de 10% dos habitantes são da China continental e quase metade do Distrito de Pequim, incluindo as regiões Norte e Noroeste. A doença foi descrita pela primeira vez em uma carta enviada às autoridades sanitárias no dia 15 de março. Três dias depois, um estudo genético para o vírus causou grande preocupação aos especialistas em transmissão, que acreditavam que a doença se espalhava através de duas regiões do país. A China continental relatou que apenas 8 pessoas foram diagnosticadas no país. Os vírus estão propagando-se por todo o continente europeu, do Ásia e de diversas partes do globo. De acordo com análises recentes do Centro de Controle e Prevenção da Doenças, em 14 de março, havia um total de 785 casos confirmados confirmados em todo o mundo. O surto da doença chegou aos Estados Unidos, com o surto de gripe na cidade de Wuhan, China, sendo o quarto maior já registrado em um período desde a epidemia de surtos no ano de 1994. Além disso, os casos das novas epidemias trazidas pela epidemia das SARS de 2013 no Haiti em 2020 tornaram-se os maiores problemas para a saúde da China. Em 14 de março, cerca de 4,85 milhão de pessoas estavam infectadas e cerca de 8% --- >> Generated text 3 A Rússia está mais perto de se tornar o primeiro país a iniciar a distribuição de uma vacina contra o coronavírus para a população. O país anunciou hoje que concluiu parte dos testes clínicos necessários para comprovar a eficácia da imunização desenvolvida por iniciativa do governo russo. A expectativa é de que a distribuição comece já em agosto. O Papa Francisco pediu ao povo russo que confirme a data da chegada da vacina. O Papa também pediu aos cidadãos russos que realizem uma conferência de imprensa oficial para o anúncio. Em 7 de dezembro de 2016, quando se iniciou o trabalho de tradução para mais idiomas, mais de 300 pessoas no mundo tiveram acesso aos benefícios da vacina. A primeira vacina para o coronavírus foi testada no Japão em 9 de março de 2020. Em 6 de fevereiro, um estudo realizado em Taiwan revelou que a epidemia do SARS é mais provável devido ao aumento do hábito. Por causa do aumento nas visitas dos cidadãos a hospitais para verificar que a vacina é eficaz, a saúde do país começou a declinar. O ministro da Saúde japonês, Toshihiko Hayashi disse que a crise da saúde era uma consequência da melhora das medidas de prevenção e contra o coronavírus em relação ao início do período de alta infecção. A Rússia começou a distribuir a vacina no início de outubro, após a confirmação por funcionários da saúde pública de uma nova coronavírus. Foi lançada no mesmo dia em todas as regiões ocidentais do país. O total de pessoas hospitalizadas pelo vírus foi de aproximadamente 431 em Taiwan. Além disso, entre 15 e 17 de outubro, uma pessoa foi internada no Hospital Universitário de Pequim, nos arredores de Pequim, devido a um surto viral de SARS. Os sintomas de pneumonia, febre, prurido e pneumonia permaneceram altas durante toda a primeira quinzena de outubro. Os outros dois dias depois, no Hospital Universitário de Moscou, a doença causou mais mortes confirmadas do que não provocado anteriormente, com cerca de 211. O número de passageiros do Hospital Universitário de Moscou caiu 297 pessoas. A agência russa "DPS" declarou como uma das principais preocupações sobre a doença a saúde pública na República Popular da China. Em janeiro de 2020, o governo chinês lançou três programas de vacinação oral nos distritos urbanos em resposta à melhora global e a pandemia no Vale do Silício. O programa nacional de vacinação, chamado de "Omgao", consiste num conjunto de 36 cidades com um total de 1.429 municípios (em regiões mais remotas do país). A aplicação do programa foi feita em 27 --- CPU times: user 7.56 s, sys: 242 ms, total: 7.81 s Wall time: 7.8 s

Use case 2 (Top-p nucleus sampling)¶

%%time

#set top_p = 0.95, top_k = 50, temperature = 0.7, repetition_penalty = 1.2 and num_return_sequences = 3

sample_outputs = model_pt.generate(input_ids, pad_token_id=50256,

do_sample=True,

max_length=max_length,

min_length=max_length,

repetition_penalty=1.2,

temperature=0.7,

top_k=50,

top_p=0.95,

num_return_sequences=3)

for i, sample_output in enumerate(sample_outputs):

print(">> Generated text {}\n\n{}".format(i+1, tokenizer_pt.decode(sample_output.tolist())))

print('\n---')